L’intelligenza artificiale è uno strumento che può dare superpoteri, se e solo se ci si assume l’enorme responsabilità degli stessi. Tra oligopoli, divario digitale con distanze sempre più difficili da ridimensionare, le sfide che vedono l’AI protagonista sono complesse. Le conseguenze ambientali di questa tecnologia sono ingenti, per non parlare del concetto di AI come deterrenza e le implicazioni del futuro dello scopo dell’essere umano stesso.

Tutto questo a quale costo?

L’Intelligenza Artificiale ci promette efficienza, progresso, risposte immediate. Ma cosa perdiamo nel processo?

In un mondo in cui tutto è automatizzato, qual è il valore dell’intelligenza umana?

La questione non è solo tecnica, ma filosofica: se deleghiamo sempre più scelte alle macchine, che ruolo ci rimane? L’AI può generare idee, ma può davvero immaginare? Può scrivere una poesia, ma può davvero sentirla? Può analizzare milioni di volti, ma può davvero provare empatia?

Mentre le macchine diventano sempre più potenti, la nostra sfida più grande non è competere con loro, ma capire chi vogliamo essere in questo nuovo scenario.

La nostra sovrumana intelligenza e la capacità di saper porre le domande giuste:

Saper rispondere alle domande. Questa è una delle skill che ha accompagnato la nostra evoluzione.

Rispondere bene alle domande era fondamentale per ottenere buoni voti a scuola, per superare gli esami. Nessuno poteva sapere che, così facendo, avremmo perso di vista un altro talento da fare sbocciare: porre le domande giuste.

Così, l’Intelligenza Artificiale riporta il nostro modo di ragionare in una dimensione conversazionale in cui il primo input parte da noi. Spesso e volentieri l’input è proprio una domanda. La sindrome del foglio bianco può manifestarsi anche davanti a un chatbot, quasi a pregare quel grande modello di linguaggio di fare il primo passo, per non sbagliare il resto.

Porre la domanda giusta è una via percorribile anche per trovare soluzioni alternative all’oligarchia del pensiero. Ormai il dado è tratto: i pochi hanno il tutto, nessuno sa nulla e pensare di mettere una pietra sopra non è abbastanza. Così, quando i temi sul piatto sono l’ambiente e il futuro della nostra umanità, la bussola sembra impazzire, alla ricerca di una nuova rotta da seguire.

E se la soluzione fosse sotto al naso, ma, avendo spostato l’orizzonte troppo in là, la miopia regna sovrana?

Questo è il momento giusto per porre le domande, quasi come un esercizio di stile. L’importante è farlo. Ripetere. Sbagliare e riprovare.

Prendiamo l’Intelligenza Artificiale Generativa. Porre domande implica avere le idee chiare.

Chi ci segue lo sa bene: la capacità di scrivere prompt è una consecutio della buona comunicazione.

Ma quanto costa all’ambiente porre una buona domanda? E se la risposta non dovesse risultare soddisfacente, quanto costa porne un’altra? E un’altra ancora?

Immaginiamo per un attimo che una persona su tre al mondo inizi a porre domande in modo iterativo all’AI. Quante emissioni di C02 impattano su questo tipo di operazioni? Quanta acqua costa un prompt o l’elaborazione di un token?

E che tipo di futuro vogliamo costruire con la nostra umana intelligenza?

Affrontiamo una domanda alla volta per esplorare dove siamo adesso e dove possiamo arrivare.

AI e ambiente: tra impatto, sfide e scenari futuri

L’AI ha bisogno di infrastrutture potenti per funzionare. Ma queste consumano più di quanto immaginiamo. Scopriamo quanta energia richiede l’intelligenza artificiale e quali sono le sue implicazioni ambientali.

Prima di addentrarci nel complesso tema dell’impatto ambientale, diamo una definizione a un protagonista indiscusso di tutta questa storia: i Data center

Cos’è un data center?

I data center sono le “fabbriche digitali” che alimentano l’intelligenza artificiale. Strutture immense, colme di server e sistemi di raffreddamento, che processano quantità astronomiche di dati ogni secondo. Se il petrolio è stato il motore dell’industria del Novecento, oggi i data center sono il cuore pulsante della rivoluzione AI. Ma a quale prezzo? Il costo non è solo economico: energia, acqua e risorse naturali vengono consumate a ritmi vertiginosi, spesso senza che ce ne rendiamo conto.

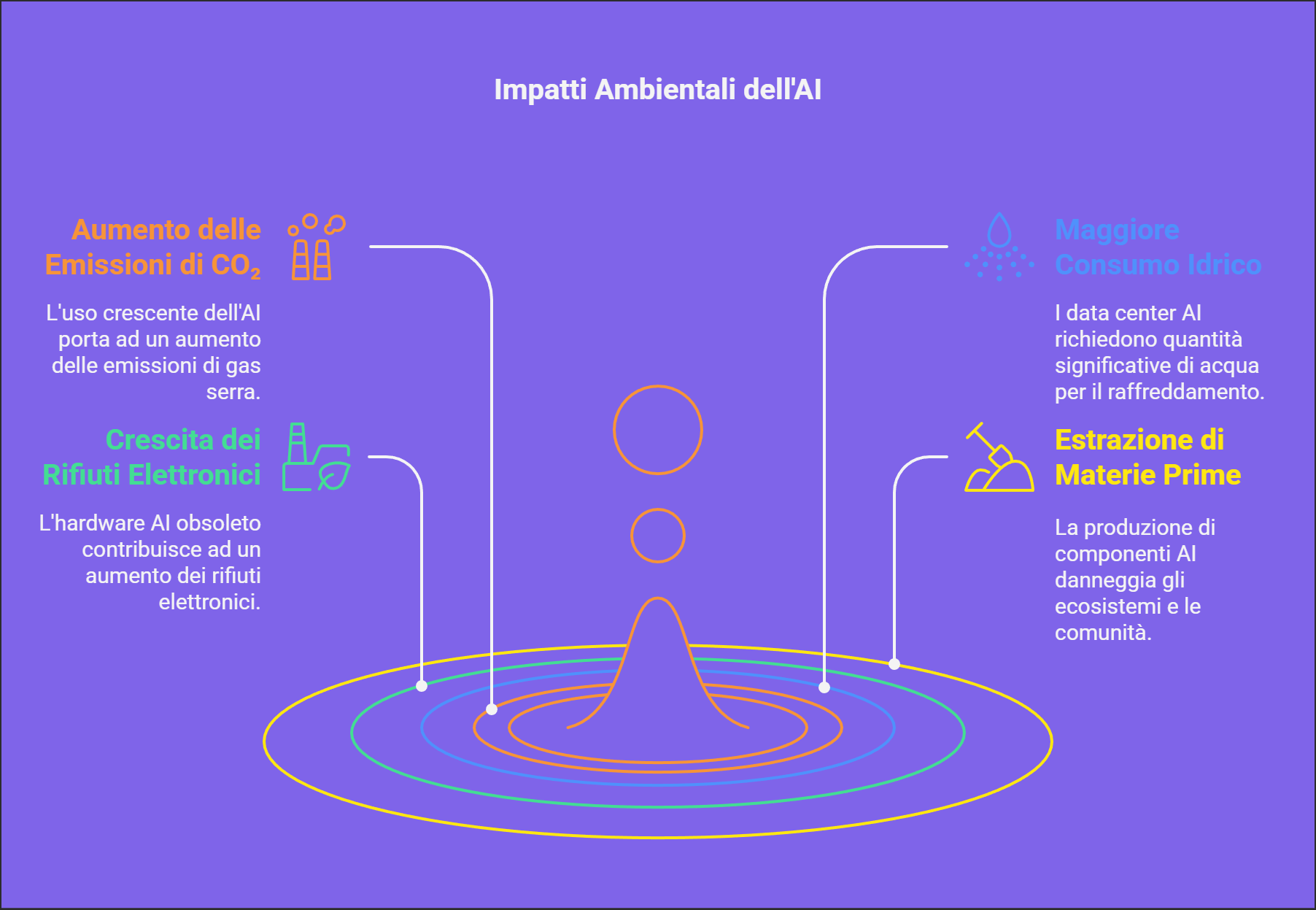

Dunque, l’Intelligenza Artificiale ha un impatto ambientale sempre più rilevante, soprattutto a causa dell’enorme quantità di risorse richieste per il suo funzionamento.

Infatti, i data center AI sono per loro natura altamente energivori, oltre a consumare grandi quantità d’acqua per il raffreddamento dei server, al fine di mantenere temperature operative ottimali.

Tutti fattori che contribuiscono a peggiorare il già complicato scenario di emergenza climatica.

I rischi ambientali dell’AI: una panoramica

L’Intelligenza Artificiale, per quanto rivoluzionaria, è anche una tecnologia altamente energivora. I data center che la alimentano consumano quantità impressionanti di energia e risorse naturali. Secondo recenti analisi, il consumo elettrico dell’AI rappresentava già l’8% dell’energia totale dei data center nel 2023, e potrebbe triplicare entro il 2028. Questo significa un impatto sempre più critico sul riscaldamento globale, sull’uso di acqua per il raffreddamento e sulla produzione di rifiuti elettronici.

Dunque, nonostante le sue potenzialità, l’IA presenta anche rischi ambientali significativi, tra cui:

- Consumo energetico: L’addestramento dei modelli di IA richiede enormi quantità di energia, spesso generate da combustibili fossili, contribuendo al riscaldamento globale 3. Secondo Statista 4, nel 2023 il consumo totale di elettricità dell’IA è stato stimato a 4,5 gigawatt (GW), circa l’8% del consumo dei data center. Si prevede che questa cifra triplicherà entro il 2028, fino al 20% del consumo energetico dei data center. Questo aumento della domanda di energia per l’IA è in contrasto con la necessità di ridurre le emissioni di gas serra e promuovere la sostenibilità ambientale 4.

- Produzione di hardware: La produzione di hardware per l’IA, come server e data center, richiede un ulteriore consumo di energia e notevoli quantità di materiali e risorse naturali3. L’estrazione e la produzione di questi metalli possono causare erosione del suolo e inquinamento.

- Rifiuti elettronici: L’obsolescenza rapida dell’hardware per l’IA genera una grande quantità di rifiuti elettronici, che possono causare ulteriore inquinamento3 1.

Consumo di acqua: I data center, essenziali per l’IA, richiedono grandi quantità di acqua per il raffreddamento, con un impatto significativo sulle risorse idriche 1.

L’impatto dell’AI sul consumo di risorse non è solo una questione teorica, ma già oggi mostra effetti tangibili su scala globale. Un esempio? Google, che nel 2023 ha registrato un aumento delle emissioni di gas serra di quasi il 50% rispetto al 2019, complice l’adozione crescente di modelli AI sempre più complessi. Se l’azienda decidesse di integrare l’intelligenza artificiale in tutte le sue ricerche, la quantità di elettricità necessaria per ogni singola richiesta potrebbe aumentare fino a 30 volte.

Ma non è solo l’energia a risentire dell’espansione dell’AI: anche il consumo d’acqua sta crescendo a ritmi preoccupanti. Sempre nel 2023, i prelievi idrici di Google sono aumentati del 14% in un solo anno, mentre Microsoft ha registrato un incremento ancora più drastico, superando il 20%. Questi numeri suggeriscono chen ragionare in ottica di “what if” oggi, previene il danno domani.

Fonti:

- AI has an environmental problem. Here’s what the world can do …, accesso eseguito il giorno febbraio 11, 2025, https://www.unep.org/news-and-stories/story/ai-has-environmental-problem-heres-what-world-can-do-about

- Welcome to State of AI Report 2024, accesso eseguito il giorno febbraio 11, 2025, https://www.stateof.ai/

- Can We Mitigate AI’s Environmental Impacts?, accesso eseguito il giorno febbraio 11, 2025, https://environment.yale.edu/news/article/can-we-mitigate-ais-environmental-impacts

- Environmental impact of AI – statistics & facts | Statista, accesso eseguito il giorno febbraio 11, 2025, https://www.statista.com/topics/12959/environmental-impact-of-ai/

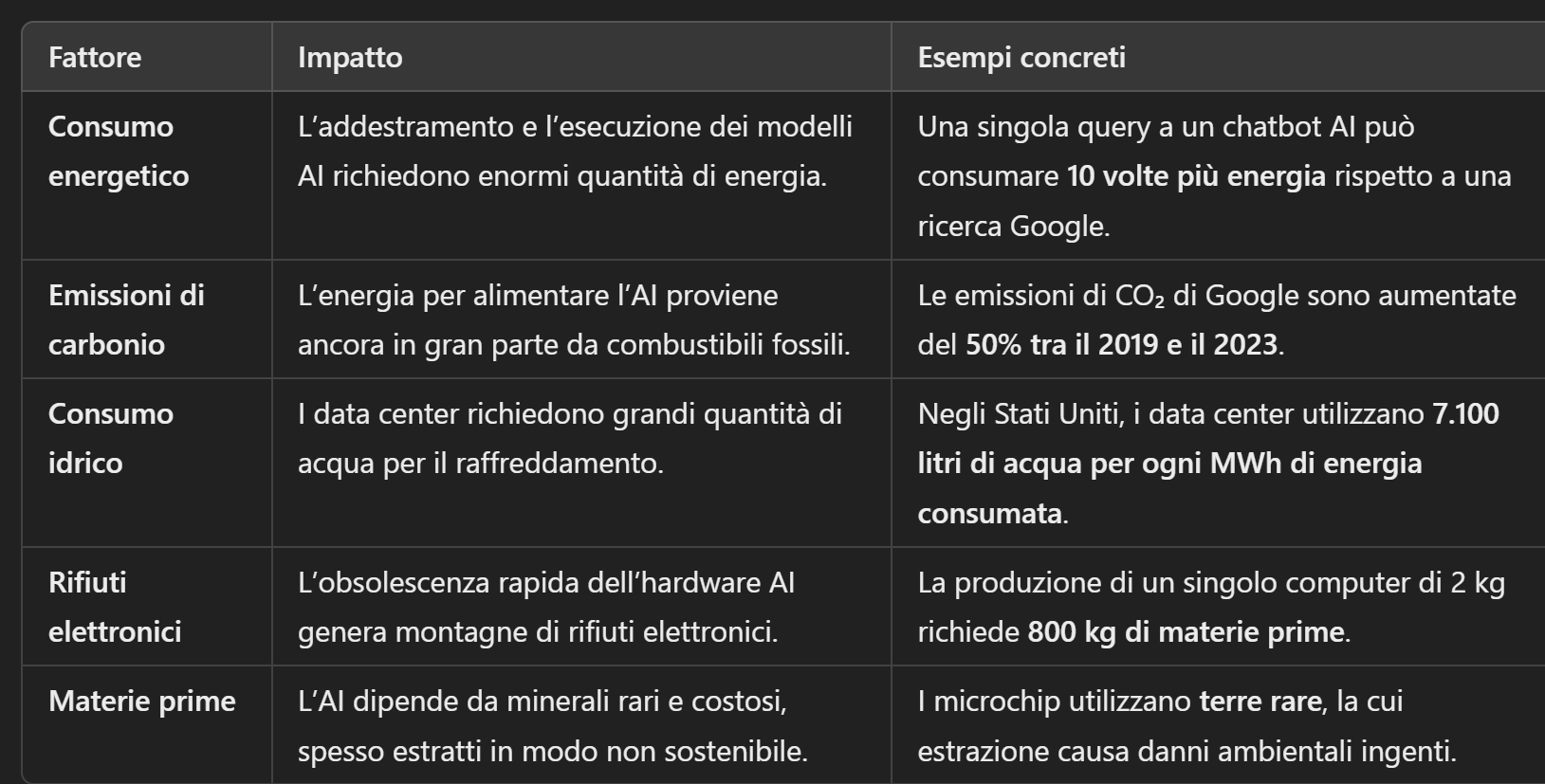

Ma quanto costa davvero l’AI all’ambiente? Il consumo di energia e risorse non è un’astrazione: ecco un quadro sintetico del suo impatto.

Valutiamo ogni singolo fattore di rischio, il tipo di impatto e per ognuno proviamo a fare un esempio concreto:

Consumo energetico per l’addestramento dei modelli AI

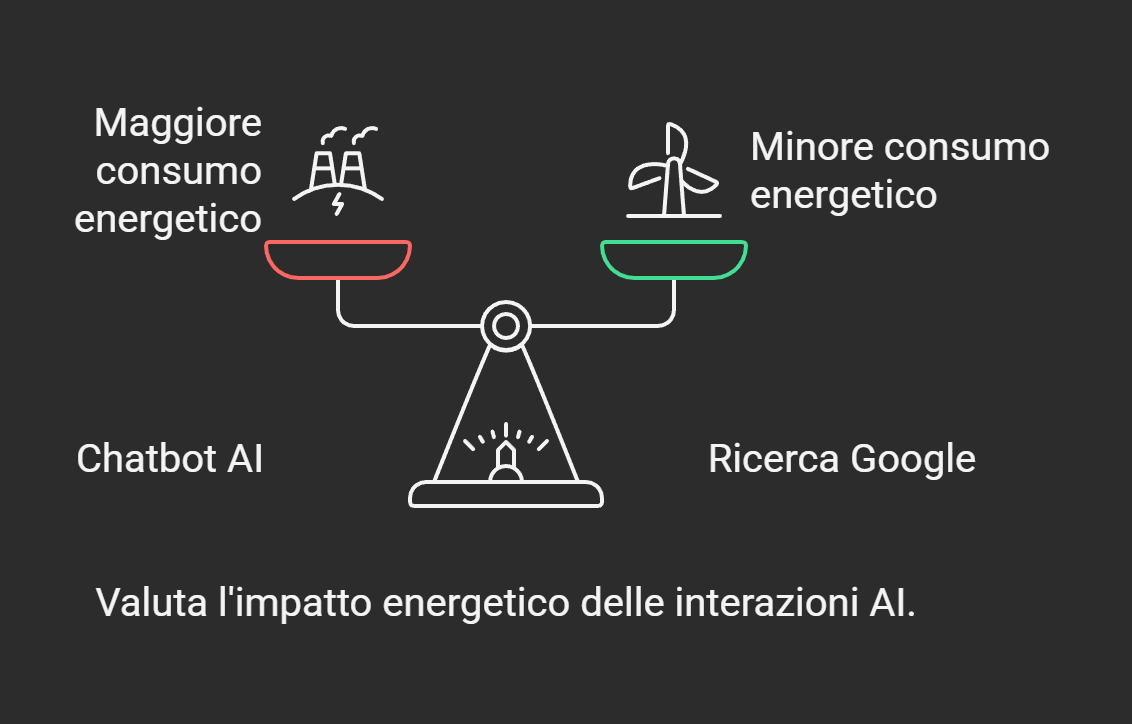

- Cos’è il consumo energetico: L’addestramento e l’esecuzione dei modelli di intelligenza artificiale richiedono enormi quantità di energia, che spesso proviene da fonti fossili.

- Esempio concreto: Una singola query a un chatbot AI può consumare fino a 10 volte più energia rispetto a una ricerca tradizionale su Google.

Emissioni di carbonio date dall’AI

- Descrizione: L’energia necessaria per alimentare l’AI contribuisce all’aumento delle emissioni di gas serra, accelerando il cambiamento climatico.

- Esempio concreto: Tra il 2019 e il 2023, le emissioni di CO₂ di Google sono aumentate di quasi il 50% proprio a causa della crescente integrazione dell’AI nei suoi servizi.

Consumo idrico

- Descrizione: I data center richiedono grandi quantità di acqua per il raffreddamento delle infrastrutture informatiche, con un impatto diretto sulle risorse idriche globali.

- Esempio concreto: Negli Stati Uniti, i data center utilizzano in media 7.100 litri di acqua per ogni megawattora di energia consumata. Nel 2023, i prelievi idrici di Google sono aumentati del 14%, mentre Microsoft ha registrato un incremento superiore al 20%.

Rifiuti elettronici

- Descrizione: L’obsolescenza rapida dell’hardware AI genera un crescente volume di rifiuti elettronici, difficili da smaltire e altamente inquinanti.

- Esempio concreto: La produzione di un computer di soli 2 kg richiede fino a 800 kg di materie prime, tra cui metalli rari e componenti difficili da riciclare.

Materie prime

- Descrizione: La produzione di hardware AI dipende da materiali rari, spesso estratti con metodi poco sostenibili che causano danni ambientali e sociali.

- Esempio concreto: I microchip utilizzati nei modelli AI richiedono elementi di terre rare, la cui estrazione intensiva può portare a deforestazione, inquinamento e sfruttamento delle risorse naturali. Questo è un tema cruciale che ha conseguenze geopolitiche notevoli. Ma in un certo senso rende anche tangibile quanto l’AI possa essere intesa come deterrenza e come la stessa non potrebbe esistere senza il supporto di materie prime rare e preziose.

Voilà una tabella elaborata con l’aiuto dell’AI generativa:

Quanta energia consuma l’AI?

Una panoramica sul consumo energetico e emissioni di CO₂

Ogni giorno nel mondo si producono più di 400 miliardi di gigabyte di dati, l’equivalente della memoria di più di tre milioni di smartphone. Se pensiamo inoltre, che per addestrare GPT-4, ci sono voluti 4900 miliardi di data point (singole unità di informazione), lo scenario in termini di impatto ambientale si complica.

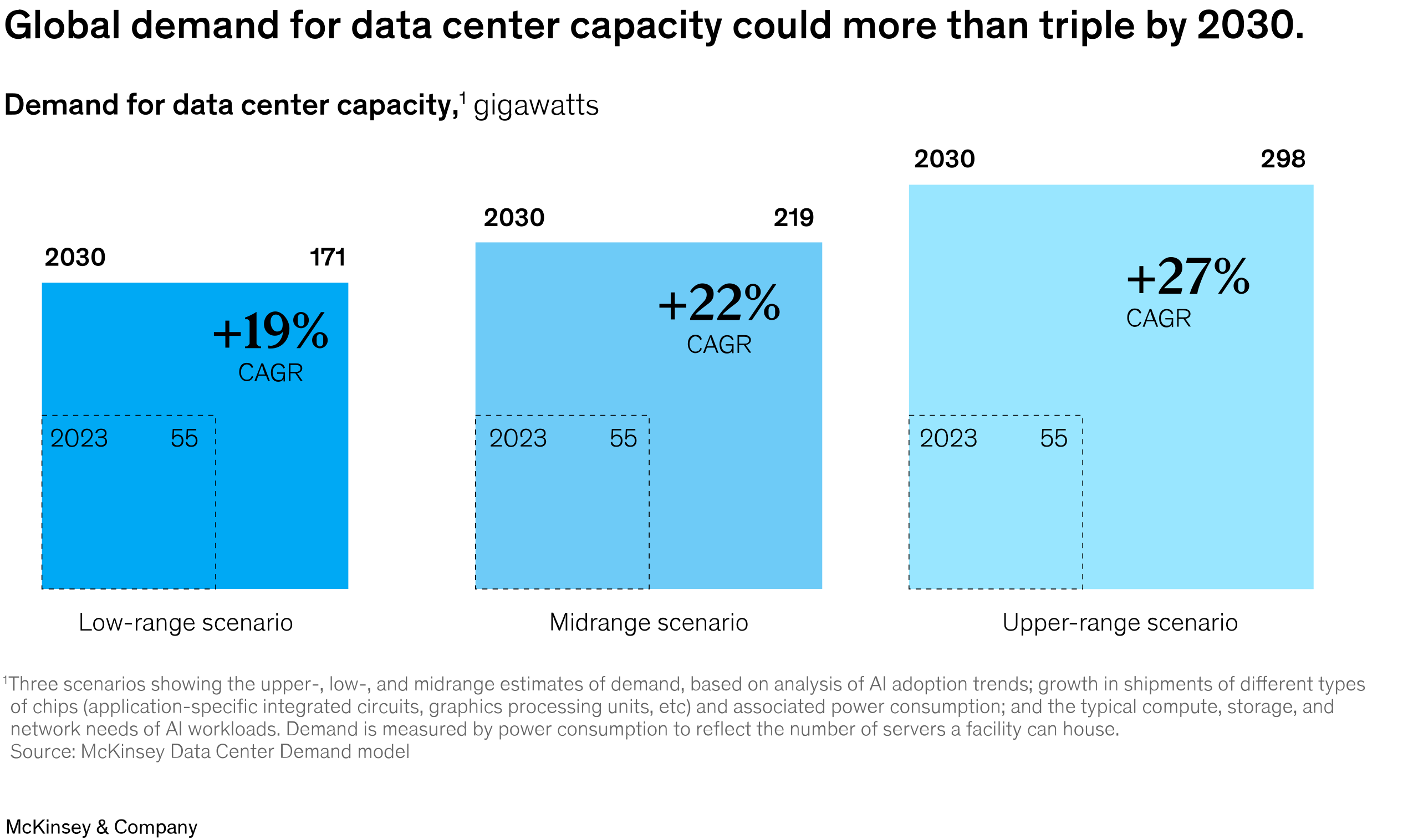

Secondo un’analisi McKinsey, la domanda globale di capacità dei data center potrebbe più che triplicare entro il 2030. Nel 2023, i data center globali consumavano circa 55 gigawatt di energia, ma a seconda dello scenario di crescita, questa cifra potrebbe raggiungere tra 171 e 298 gigawatt entro il 2030.

La maggior parte di questa energia proviene ancora da combustibili fossili, con un conseguente impatto negativo sulle emissioni di CO₂ e sul riscaldamento globale.

Produzione di hardware e rifiuti elettronici: tra materie prime rare e problemi di smaltimento

I chip avanzati, le GPU e i server specializzati richiesti per l’AI implicano un intenso sfruttamento di materiali come litio, cobalto e terre rare, con conseguenze come erosione del suolo e inquinamento delle acque. Inoltre, la rapida obsolescenza di questi dispositivi genera un aumento dei rifiuti elettronici, un problema sempre più critico data la difficoltà nel riciclare componenti avanzati e il crescente volume di scarti tecnologici.

Data Center e Consumo idrico per il raffreddamento

I data center utilizzano enormi quantità di acqua per mantenere operativi i server a temperature ottimali. Nel 2023, il prelievo idrico di Google è aumentato del 14%, mentre quello di Microsoft è cresciuto di oltre 20% rispetto all’anno precedente.

Esempi concreti di impatto ambientale

- Google e il consumo energetico dell’AI: l’aumento dell’uso dell’IA ha portato a un incremento delle emissioni di gas serra del 50% tra il 2019 e il 2023. Se l’IA fosse integrata in tutte le ricerche di Google, il fabbisogno energetico di ogni singola query potrebbe aumentare fino a 30 volte.

- Crescita dei data center AI-driven: con l’espansione dell’AI, la richiesta di strutture fisiche per l’elaborazione dei dati è in crescita, accelerando la necessità di energia e acqua su scala globale.

Data center: la differenza la fa il luogo

Se ci si chiede come mai la Groenlandia possa far gola ai più, la risposta riguarda anche il clima freddo come nuovo bene di lusso.

Oltre al consumo energetico, la localizzazione dei data center, motori dell’AI, influisce significativamente sul loro impatto ambientale. In molte regioni, come la Virginia negli Stati Uniti, l’energia è ancora fortemente dipendente dai combustibili fossili, rendendo l’operatività dei data center altamente emissiva in termini di CO₂. Inoltre, i data center costruiti in aree con scarsa disponibilità idrica aggravano la competizione per le risorse naturali, aumentando il rischio di crisi idriche locali.

Cosa stanno facendo le aziende per mitigare l’impatto ambientale? Vediamo a che punto è la transizione verso le rinnovabili:

Per mitigare l’impatto ambientale dell’AI, le aziende stanno sperimentando approcci innovativi. Tra le soluzioni ci sono i progressi nella tecnologia del raffreddamento dei server, e l’utilizzo di acqua riciclata o non potabile.

Oltre al consumo energetico, la localizzazione dei data center influisce significativamente sull’ impatto ambientale. In molte regioni, come la Virginia negli Stati Uniti, l’energia è ancora fortemente dipendente dai combustibili fossili, rendendo l’operatività dei data center altamente emissiva in termini di CO₂. Inoltre, i data center costruiti in aree con scarsa disponibilità idrica aggravano la competizione per le risorse naturali, aumentando il rischio di crisi idriche locali.

Questa problematica diventa ancora più rilevante considerando che, secondo un’analisi di McKinsey & Company, la domanda globale di capacità dei data center potrebbe più che triplicare entro il 2030, con uno scenario che prevede un consumo compreso tra 171 e 298 gigawatt. La spinta principale deriva dalla crescente necessità di potenza computazionale per supportare l’AI, che da sola rappresenterà circa il 70% della domanda totale entro il 2030.

Con la crescente domanda di capacità computazionale per supportare l’AI, aziende e governi si trovano di fronte alla necessità di ripensare la localizzazione dei data center, adottando strategie più sostenibili ed efficienti. Una delle principali direzioni intraprese è la transizione verso energie rinnovabili: molte aziende stanno già spostando le proprie infrastrutture in regioni dove l’energia solare ed eolica sono abbondanti, riducendo così la dipendenza dai combustibili fossili e abbattendo le emissioni di CO₂.

Un altro aspetto cruciale è l’ottimizzazione della vicinanza agli utenti. Con il crescente utilizzo dell’AI, la necessità di elaborare dati in tempo reale diventa sempre più pressante. Per questo motivo, invece di affidarsi a pochi mega-data center centralizzati, le aziende stanno investendo in strutture più distribuite sul territorio, che permettono di ridurre la latenza e il consumo energetico legato alla trasmissione dei dati su lunghe distanze.

Infine, c’è la sfida della gestione della scarsità idrica. I data center richiedono grandi quantità di acqua per il raffreddamento, e la loro presenza in zone già colpite da stress idrico può aggravare la competizione per le risorse locali. Per affrontare questa problematica, molte aziende stanno sperimentando tecnologie di raffreddamento avanzate, come il raffreddamento a immersione liquida, che permette di dissipare il calore in modo più efficiente, riducendo il fabbisogno idrico. Inoltre, l’utilizzo di acqua riciclata o non potabile sta diventando una soluzione sempre più adottata per minimizzare l’impatto sulle comunità locali e garantire una gestione più sostenibile delle risorse.

L’AI stessa può essere sfruttata per migliorare l’efficienza dei data center. Come?

L’impatto ambientale dell’AI è un problema di uno scenario futuro che è bene affrontare a partire da adesso. Una nota positiva è la seguente: è opportuno considerare come la tecnologia AI possa essere messa a servizio della transizione ecologica. Un esempio? Nella climatologia e nell’ingegneria energetica, sono molti gli studiosi che guardano con curiosità a tutte le opportunità che derivano dall’AI , soprattutto per la gestione delle reti. Ad esempio, le energie rinnovabili, nostra grande risorsa, sono spesso intermittenti o comunque sottoposte a blackout. In questo senso, l’AI può rappresentare una risorsa per una progettazione snella di questo tipo di infrastrutture.

Infatti, grazie ad algoritmi avanzati di machine learning, l’AI sta dimostrando di poter ottimizzare l’uso dell’energia, prevedere il fabbisogno di raffreddamento e ridurre gli sprechi.

Inoltre, l’AI può essere impiegata per la manutenzione predittiva dell’hardware e per la sicurezza dei data center, individuando attività insolite prima che si verifichino problemi reali.

L’efficacia di queste strategie tuttavia, dipenderà dalla velocità di adozione su larga scala e dalla capacità di sviluppare infrastrutture AI più sostenibili. Microsoft ad esempio utilizza l’AI per monitorare e ridurre il consumo d’acqua nei suoi data center, migliorando l’efficienza del raffreddamento evaporativo e limitando l’uso di acqua nelle aree con stress idrico, mentre IBM sta sviluppando AI in grado di prevedere quando i componenti hardware dei data center raggiungeranno la fine del loro ciclo di vita, consentendo una manutenzione più efficiente e sostenibile.

L’adozione di queste tecnologie rappresenta sì un passo fondamentale per ridurre l’impatto ambientale dell’AI, ma la sfida principale resta la loro implementazione su larga scala. Se da un lato soluzioni come il raffreddamento a immersione liquida, l’uso di acqua riciclata e l’ottimizzazione tramite AI dimostrano già benefici concreti in termini di efficienza energetica e riduzione degli sprechi, dall’altro è essenziale che vengano integrate in modo sistemico nei nuovi data center e nelle infrastrutture esistenti.

Affinché l’AI non diventi un ulteriore fattore di pressione ambientale, sarà cruciale un impegno congiunto tra aziende tech, governi e istituzioni, incentivando politiche di sostenibilità e regolamentazioni più stringenti. Il futuro dell’AI non dipenderà solo dalle sue capacità computazionali, ma anche da come riusciremo a bilanciare innovazione e sostenibilità, garantendo che la rivoluzione digitale sia compatibile con la tutela delle risorse del pianeta.

L’AI e l’ambiente sono destinati a convivere, ma la domanda cruciale è: come possiamo ridurre il suo impatto?

Se da un lato i numeri raccontano di un’intelligenza artificiale sempre più energivora, dall’altro emergono strategie e tecnologie per rendere questa innovazione più sostenibile. Alcune aziende e governi si stanno già muovendo in questa direzione.

Come possiamo mitigare il rischio ambientale? Un po’ di elementi da considerare e piccoli passi in avanti:

Regolamentazione più stringente

I governi stanno iniziando a richiedere maggiore trasparenza sulle implicazioni ambientali dell’AI. Negli Stati Uniti, ad esempio, è stato introdotto l’Artificial Intelligence Environmental Impacts Act del 2024, che obbliga l’Environmental Protection Agency (EPA) a studiare l’impatto dell’AI e il National Institute of Standards and Technology (NIST) a sviluppare linee guida per il monitoraggio e la riduzione dei consumi.

Efficienza degli algoritmi e la loro ottimizzazione

L’ottimizzazione degli algoritmi è una delle strategie più promettenti per ridurre i consumi energetici e migliorare la sostenibilità dell’AI. Google, ad esempio, sta investendo nello sviluppo di modelli di deep learning più efficienti, capaci di mantenere prestazioni elevate con un minor impatto ambientale. Parallelamente, alcune aziende stanno esplorando soluzioni innovative per ridurre gli sprechi, come il riciclo dell’acqua utilizzata nei data center e il riutilizzo dei componenti hardware, limitando così il consumo di risorse naturali e la produzione di rifiuti elettronici.

Anche DeepSeek ha dimostrato che un’AI più snella è possibile. Il suo debutto ha scosso il settore, non solo per le sue capacità, ma per aver evidenziato un nuovo approccio all’efficienza computazionale. Il suo modello utilizza un’architettura meno energivora, sollevando importanti riflessioni sull’industria dei semiconduttori e dei chip. Questo apre la strada a un ripensamento delle infrastrutture AI, dimostrando che è possibile ottenere risultati degni di nota mitigando il consumo energetico.

Data center più sostenibili

Un’altra soluzione chiave riguarda la transizione verso data center alimentati da energie rinnovabili. Alcune grandi aziende tecnologiche, come Apple e Facebook, stanno già investendo in server ad alta efficienza e strutture che sfruttano energia solare ed eolica per ridurre la loro impronta ecologica.

Integrazione delle politiche ambientali nelle strategie AI

Anche le istituzioni internazionali stanno cercando di rendere l’AI più sostenibile. L’Unione Europea sta lavorando all’integrazione delle considerazioni ambientali nella sua strategia sull’AI, ponendo sempre più attenzione a normative che incentivino l’uso responsabile delle risorse e la riduzione delle emissioni di carbonio.

Sicuramente l’AI offre enormi opportunità in tema di efficienza energetica, nel monitoraggio ambientale, soprattutto per lo studio e la tutela della biodiversità, ma anche per tracciare le emissioni atmosferiche. Ultimo, ma non meno importante, è l’applicazione dell’AI in tema di prevenzione dei disastri naturali.

Tecnologia sostenibile: una questione di scelte

L’AI è uno strumento potente, ma il suo sviluppo ha un costo ambientale e sociale elevato. Se da un lato può ottimizzare processi e ridurre sprechi, dall’altro il suo consumo di energia e risorse rischia di accelerare la crisi climatica. A questo punto, dobbiamo chiederci: abbiamo davvero bisogno di un AI che generi contenuti infiniti, se il prezzo è un impatto ecologico insostenibile?

Le aziende tech stanno sviluppando soluzioni più sostenibili, ma il cambiamento parte anche dall’uso consapevole da parte di ognuno di noi. È davvero necessario generare decine di immagini con AI solo per un post sui social? O chiedere all’AI di riscrivere una frase mille volte? Ogni azione digitale ha un costo, anche se invisibile.

La tecnologia non è neutrale: dipende da come la usiamo. E oggi più che mai, dobbiamo chiederci se la direzione che stiamo prendendo è quella giusta.

L’AI ha ancora molta strada da fare per diventare un’alleata dell’ambiente, ma nel frattempo sta già trasformando profondamente un altro aspetto cruciale della società: il mondo del lavoro. Se da un lato l’automazione può migliorare l’efficienza di molte professioni, dall’altro solleva interrogativi sulle competenze necessarie per il futuro e sul significato stesso di Intelligenza.Il vero tema, quindi, non è se l’AI prenderà il nostro posto, ma come possiamo prepararci a un mondo in cui l’intelligenza artificiale è parte integrante del lavoro. Questo porta a domande cruciali: quali competenze diventeranno imprescindibili? Quali nuovi ruoli emergeranno?

AI e futuro del lavoro

Oltre all’impatto ambientale, l’IA ha anche un impatto sociale significativo. Da un lato, l’IA può automatizzare task ripetitivi, migliorare l’assistenza sanitaria e fornire soluzioni innovative per affrontare le sfide sociali. Dall’altro lato, l’IA può portare alla perdita di posti di lavoro, alla discriminazione algoritmica e all’aumento delle disuguaglianze . Inoltre, è importante considerare le preoccupazioni relative all’influenza dei pregiudizi umani sull’IA, all’abuso dei dati e ai potenziali danni alla salute fisica e mentale.

Ebbene, il binomio AI – efficienza pare essere indissolubile. Ma non è forse una trappola? Prima di poter rispondere alla domanda, bisognerebbe comprendere cos’è e come si misura l’efficienza. Quali sono i criteri e i KPI che indicano se e come l’Intelligenza Artificiale possa davvero rappresentare un plus?La mitigazione delle attività ripetitive può essere considerato il primo KPI da cui partire?

La consuetudine è quella di sentire spesso e volentieri che l’AI “automatizza task ripetitivi”, il ché crea un po’ di confusione tra quella che è l’automazione e quella che, invece, è l’augmentation, ovvero la capacità di collaborare con l’AI generativa per attività complesse che, tuttavia, richiedono una grande chiarezza d’intenti prima di digitare il prompt. In altre parole, se non si hanno le idee chiare a monte, nessuna AI Generativa potrà essere d’aiuto.

Quanto ai lavori ripetitivi , è interessante notare come l’addestramento dell’AI Generativa sia frutto di un enorme lavoro ripetitivo. Un esempio? Le persone che etichettano dati necessari per addestrare la macchina. Infatti, l’attuale boom di AI è nato proprio da uno sforzo immane di lavoro tedioso. Un paradosso, se solo pensiamo all’obiettivo che dovrebbe avere l’AI, ma che fa luce su un altro aspetto: le AI generative offrono modelli di mondo preconstruiti con un’ingente quantità di schemi e bias. La buona notizia? Il fattore esperienziale umano è l’unico elemento che può fare la differenza per ottenere un Ai Generativa migliore, realmente inclusiva.

Tutto è nato dal lavoro ripetitivo

L’automazione del lavoro non è un fenomeno recente. Fin dalla rivoluzione industriale, il progresso tecnologico ha sempre avuto come obiettivo la riduzione della fatica umana e l’aumento della produttività, sostituendo progressivamente l’uomo nei compiti più ripetitivi e logoranti.

L’Intelligenza Artificiale rappresenta solo l’ultima tappa di questa evoluzione, portando l’automazione oltre il semplice lavoro manuale e meccanico, fino a toccare attività cognitive, decisionali e creative.

Dall’automazione meccanica all’automazione intelligente

Nei primi decenni del XX secolo, l’introduzione delle catene di montaggio e dei macchinari industriali ha rivoluzionato il mondo del lavoro. Le mansioni più ripetitive e fisicamente impegnative venivano affidate alle macchine, mentre agli esseri umani restavano ruoli di supervisione e controllo.

Con l’avvento dell’informatizzazione e dei computer, l’automazione si è spostata anche verso lavori di calcolo, gestione dati e analisi. Software e algoritmi hanno iniziato a sostituire il lavoro umano nelle attività amministrative e contabili, aumentando l’efficienza e riducendo il margine di errore.

Oggi, con l’Intelligenza Artificiale e l’automazione cognitiva, assistiamo a un nuovo salto di qualità:

– L’AI non si limita più a eseguire compiti ripetitivi, ma può prendere decisioni basate sui dati.

– Impara dai propri errori, migliorando continuamente le sue prestazioni.

– Può interagire in modo naturale con gli esseri umani, generando contenuti, elaborando testi, riconoscendo immagini e traducendo lingue in tempo reale.

Dal lavoro ripetitivo all’AI Generativa

L’ultimo grande cambiamento è stato l’arrivo dell’AI Generativa, che ha reso possibile l’automazione di processi creativi, tradizionalmente considerati esclusivamente umani. Testi, immagini, video, musica e persino codice di programmazione possono ora essere generati autonomamente da modelli avanzati come ChatGPT, Midjourney, Gemini, Flux e via dicendo.

Ciò solleva domande cruciali: quali tipi di lavoro rimarranno “esclusivamente umani”?

- Se l’AI è in grado di scrivere articoli, realizzare grafiche o comporre musica, quali competenze diventeranno essenziali per il lavoratore del futuro?

- Il valore del lavoro umano sarà sempre più legato alla capacità di usare l’AI in modo strategico e non solo all’esecuzione diretta di un compito?

Collaborare con l’Intelligenza Artificiale Generativa è una grande opportunità per immergersi in scenari “what if”: questo è un vantaggio in un mondo sempre più complesso e frammentario dove ogni certezza vacilla o cambia forma ad una velocità mai vista prima. Una delle prime skill potenziate dall’AI è proprio il pensiero critico come possiamo notare da un recente report di Antrophic, l’azienda che ha creato l’LLM Claude , ma è importante preservare anche la fragilità della stanchezza umana, un elemento fondamentale per sedimentare le esperienze. Se c’è una cosa che l’AI, almeno per ora, non riesce a sintetizzare è il dato esperienziale olfattivo, tattile, umorale. Proprio per questo, siamo noi a dover supervisionare l’output di un’AI e sempre noi a tenere quelle redini. La qualità della domanda farà la differenza e gli impatti saranno enormi, a partire dal ruolo delle lavoratrici e lavoratori, fino all’infosfera.

La differenza tra l’intelligenza umana e l’Intelligenza Artificiale: l’arte di sedimentare e rallentare

L’Intelligenza Artificiale Generativa ci offre scenari “what if” infiniti, aprendo nuove prospettive in un mondo sempre più in rapido mutamento. Tuttavia, mentre l’AI può aiutarci a esplorare possibilità alternative e affinare il pensiero critico, non può sostituire la profondità dell’esperienza umana. Per quanto sofisticata, un’AI non ha memorie sensoriali, né può provare emozioni o percepire il mondo attraverso i sensi. Può analizzare migliaia di descrizioni di un tramonto, ma non potrà mai sentire il calore del sole sulla pelle o il profumo della salsedine nell’aria.

La nostra intelligenza si nutre di esperienze dirette, di momenti di pausa, di intuizioni che nascono dal vissuto. Perfino la fatica e la stanchezza giocano un ruolo cruciale nel sedimentare le esperienze e dare forma alla nostra coscienza. L’AI è instancabile, ma noi esseri umani abbiamo bisogno di rallentare, di riflettere, di elaborare. Ed è proprio in questa apparente fragilità che risiede la nostra forza: il tempo necessario per assimilare un errore, per modificare una prospettiva, per generare un’idea veramente nuova.

L’intelligenza emotiva: il confine invalicabile dell’AI

Se l’AI può superare l’essere umano nell’analisi dei dati e nella capacità di sintesi, rimane ancora lontana dal comprendere e gestire le emozioni. L’intelligenza emotiva non è solo la capacità di riconoscere sentimenti propri e altrui, ma è anche il fondamento delle relazioni umane e della nostra capacità di creare valore in un mondo complesso, come sottolineato in questo video di Sara Malaguti. L’empatia, la consapevolezza del contesto, l’intuizione che ci porta a leggere tra le righe—sono tutte capacità insostituibili che solo l’essere umano può mettere in campo.

Nel lavoro, nell’arte, nelle decisioni strategiche, ciò che ci distingue dalle macchine è la capacità di ascoltare, di adattarci all’imprevisto e di costruire connessioni profonde con gli altri. Un leader, un medico, un insegnante, un artista non si limitano a interpretare dati: entrano in sintonia con chi hanno di fronte, colgono le sfumature, prendono decisioni che tengono conto non solo della logica, ma anche della sensibilità e del contesto umano.

Un punto essenziale di questa riflessione è che l’intelligenza umana non è solo elaborazione logica, ma anche empatia, esperienza e interpretazione del contesto. Immaginiamo una conversazione tra un paziente e un medico: l’AI può analizzare sintomi e proporre diagnosi basate su milioni di dati, ma può davvero cogliere l’ansia di un paziente? Comprendere il non detto? Adattare la comunicazione a una persona in difficoltà?

L’intelligenza emotiva si sviluppa attraverso la vita vissuta: impariamo a leggere le espressioni facciali, a riconoscere il tono della voce, a cogliere il contesto emotivo. L’AI può simulare queste capacità, ma non le prova. Può riconoscere che una persona è triste, ma non può capire cosa significhi esserlo, né trarne una connessione autentica. Questa capacità di creare empatia e costruire relazioni è ciò che rende insostituibile l’intelligenza umana.

In un’epoca in cui l’AI diventa sempre più integrata nelle nostre vite, il nostro vero superpotere non sarà competere con le macchine sulla velocità di calcolo, ma valorizzare ciò che ci rende unici: la capacità di ascoltare, di percepire sfumature e di costruire connessioni profonde con gli altri.

Supervisionare l’AI: la qualità della domanda fa la differenza

Per quanto avanzata, l’AI rimane uno strumento, e come ogni strumento, la sua efficacia dipende da chi lo utilizza. Un prompt ben formulato può generare insight straordinari, ma solo un essere umano può valutare la qualità e l’affidabilità di quell’output. In un mondo in cui i modelli AI possono produrre testi, immagini e persino decisioni strategiche, il nostro ruolo non è quello di accettare passivamente il risultato, ma di interrogarlo, contestualizzarlo e rifinirlo con il nostro giudizio critico.

La capacità di porre domande complesse e di interpretare le risposte è oggi più importante che mai. Se affidiamo ciecamente le nostre decisioni alle macchine, perdiamo la nostra sovranità. Ma se utilizziamo l’AI per ampliare le nostre possibilità di pensiero, per esplorare scenari inediti, per affinare il nostro sguardo sul mondo, allora possiamo fare un passo avanti nella nostra evoluzione come esseri umani.

L’equilibrio tra automazione e umanità: una scelta consapevole

Il futuro dell’Intelligenza Artificiale non è una battaglia tra uomo e macchina, ma un confronto tra scelte consapevoli e delega incondizionata. Possiamo accettare passivamente che le AI prendano decisioni per noi, oppure possiamo assumerci la responsabilità di guidarne l’evoluzione con etica e intelligenza. In questa era di trasformazione, non è solo l’AI a dover migliorare: è l’essere umano che deve evolversi, sviluppando nuove competenze, consolidando il proprio pensiero critico e preservando ciò che lo rende unico.

L’AI ci offre infinite opportunità, ma l’anima del futuro è ancora nelle nostre mani.

L’intelligenza umana ha ancora un ruolo?

L’Intelligenza Artificiale sta ridefinendo il mondo, ma il futuro non è scritto. Possiamo scegliere se delegare le nostre scelte alle macchine o riaffermare la centralità dell’intelligenza umana.

Il valore dell’essere umano non sta nella velocità con cui processa dati, ma nella sua capacità di dare significato alle cose. Nel coraggio di cambiare idea. Nella sensibilità di cogliere emozioni che sfuggono agli algoritmi.

Non dobbiamo solo chiederci quanto diventeranno intelligenti le macchine. Dobbiamo chiederci quanto vogliamo restare intelligenti noi.

Vuoi scaricare l’articolo in formato pdf e leggerlo più comodamente?

Puoi farlo da qui!

Anna Iorio, CTO e Digital Marketing Manager, Cristina Boccaccini, Digital Marketing Manager e Responsabile dell’area Playsphera, Francesca Mari, Client Director.

Appassionate di creatività e innovazione, campionesse di brainstorming.

Che si tratti di mettere le mani in pasta con nuovi tool o esplorare le ultime novità in materia di Intelligenza Artificiale, Marketing e Formazione Game-Based, Anna e Cristina sono pronte a condividere le loro scoperte e conoscenze.

Francesca, proveniente dal mondo del Digital Marketing gentile e aperto allo scambio costruttivo, segue in prima persona i percorsi di accompagnamento dei nostri clienti nel mondo del digital marketing.

Sul Blog trovate articoli scritti sapientemente a più mani, le loro.